AIはコードを書くかもしれませんが、スキルはそれを保護します。

当社のエンタープライズ向けセキュア・コーディング・プラットフォームは、配信を遅らせることなく、人間が生成したコードと AI が生成したコードの両方を保護するために必要なスキルを身に付けます。

従来のセキュリティトレーニングは次のことに重点を置いています —機能ではありません。スタティックスキャンは問題が発生した後に問題を検出します。 ソフトウェアリスクを軽減するには、安全なコーディング動作を改善する必要がある 安全なコーディング機能は、効果的なAIソフトウェアガバナンスの基盤です。

Build developer capability for secure AI development

Secure Code Warrior Learning provides AI security training that builds the skills behind every commit. Developers learn to secure AI-generated code through hands-on practice across real-world AI workflows, reducing risk at the source.

安全なコーディング能力を大規模に構築

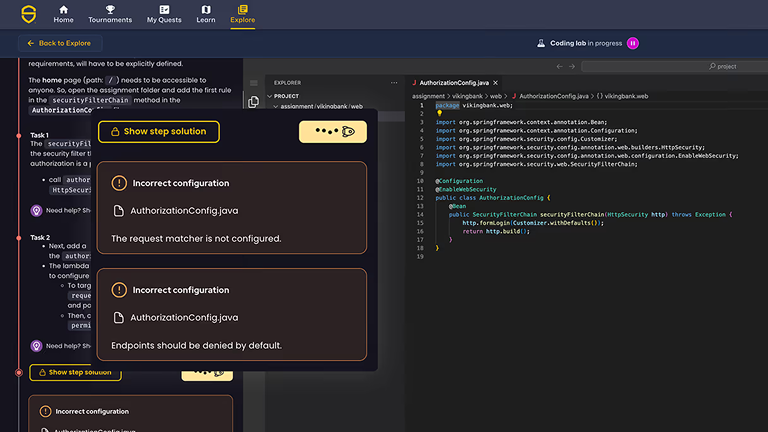

ハンズオンセキュアコーディングラボ

開発者は、75以上の言語とフレームワークにわたるインタラクティブな演習を通じて、実際の脆弱性を解決します。

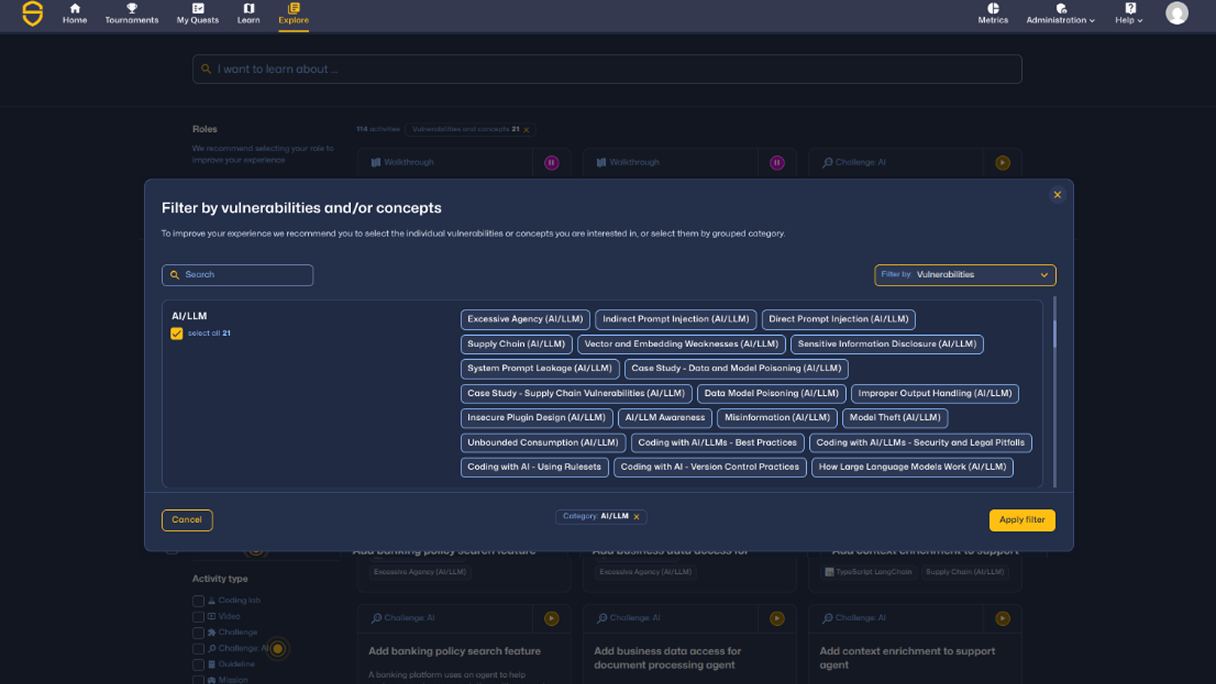

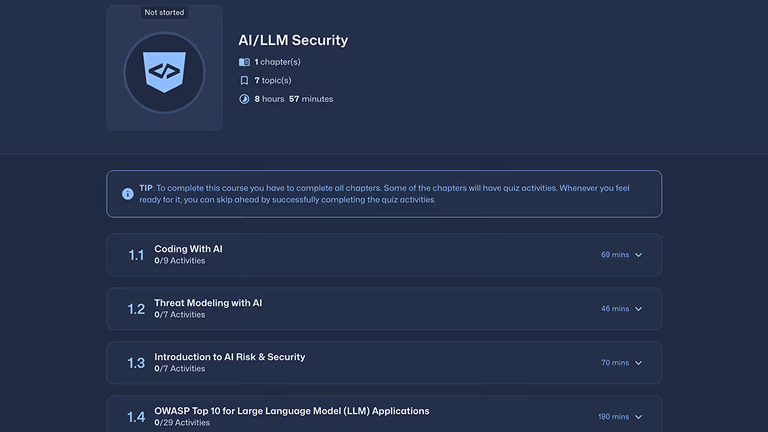

AI 固有のセキュリティモジュール

AI で生成されたコードの検証と保護、安全でないパターンの検出、AI 支援ワークフローへの安全な標準の適用を行います。

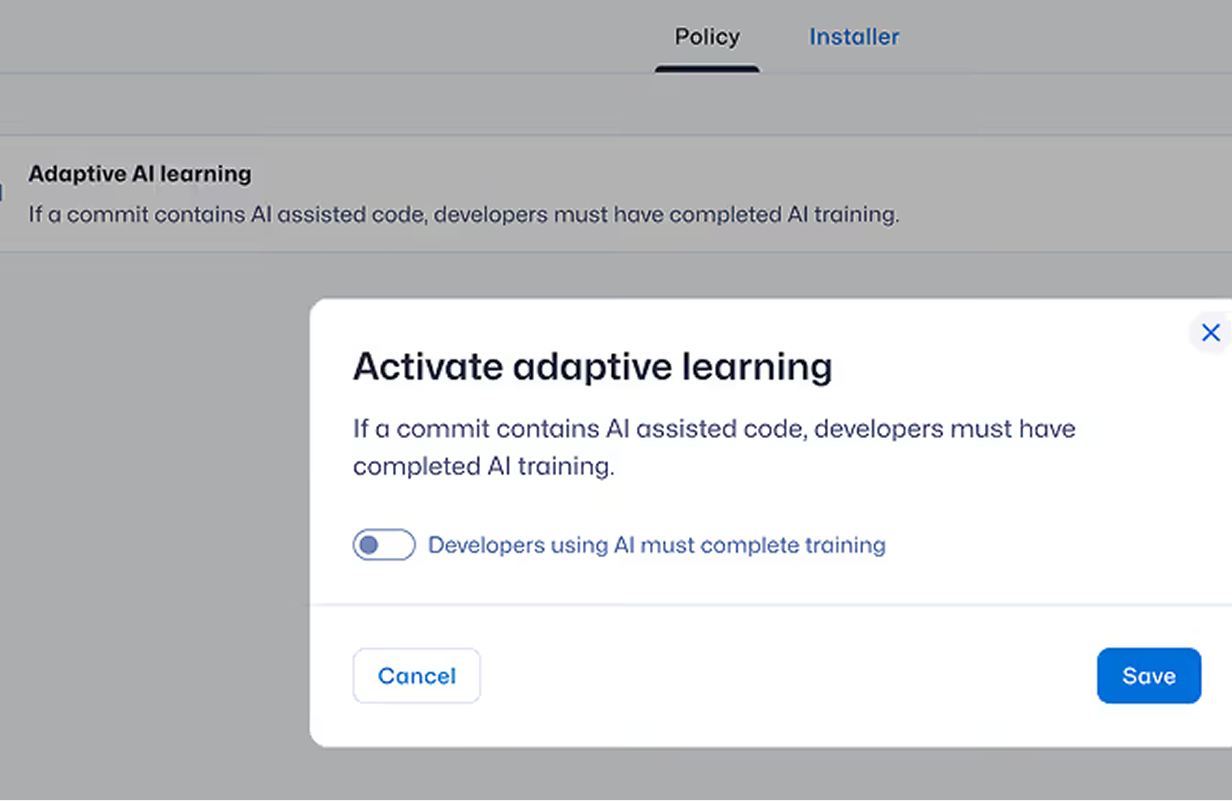

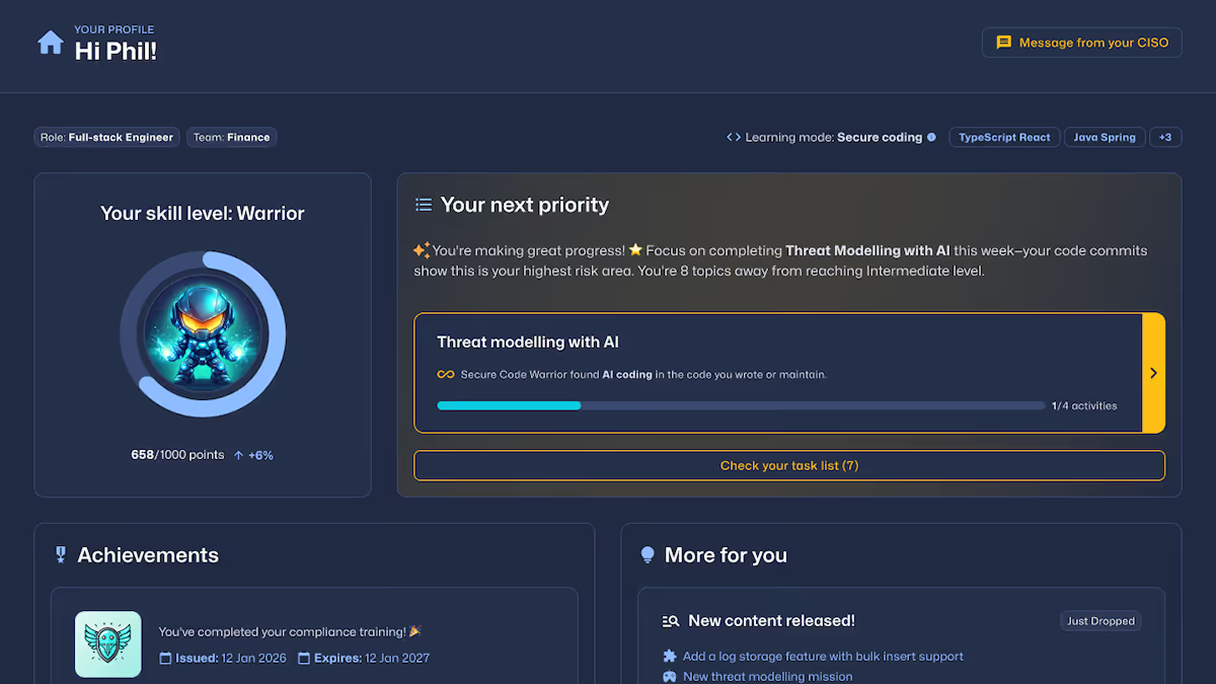

適応型学習パス

開発者の行動、コミットリスクシグナル、ベンチマークギャップに基づいて、対象を絞ったトレーニングを自動的に割り当てます。

進捗状況を測定

SCW Trust Score® を使用して、開発者の習熟度を評価し、同業他社とのベンチマークを行い、測定可能なセキュアコーディングの進捗状況を追跡できます。

实现合规

監査に対応したレポートを作成して、トレーニングをOWASPトップ10、NIST、PCI DSS、CRA、NIS2に合わせて調整できます。

由人工智能主导开发的控制平面

通过人工智能主导的开发,实现可视化、安全性和弹性,在正式运行前防范漏洞,使团队能够充满信心地快速行动。

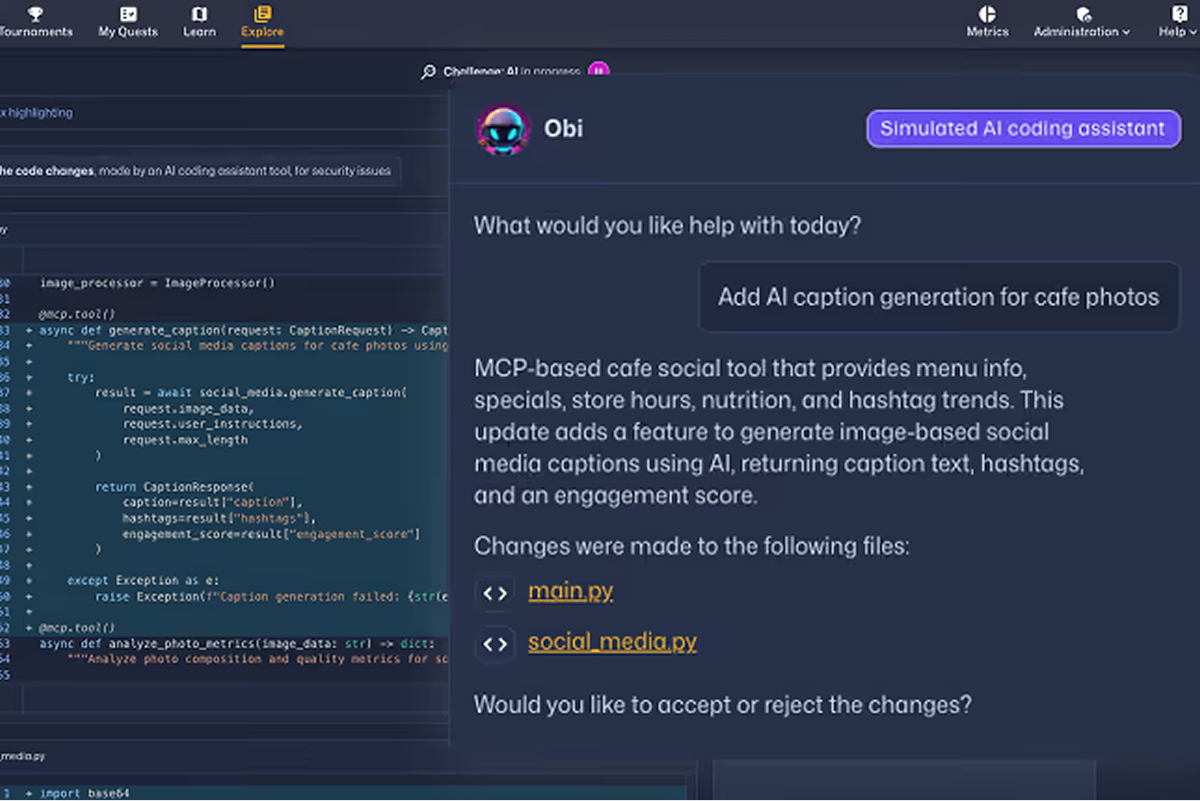

任务

编码实验室

人工智能挑战

Check out the SCW Learning Content Guide which outlines the breadth and depth of training available across the Secure Code Warrior platform, including secure coding vulnerabilities, AI security topics, programming languages, frameworks, and role-based learning paths.

Missions

从源头减轻脆弱性

Secure Code Warrior Learningは、繰り返し発生する脆弱性を減らし、安全なコーディング習慣を強化し、開発者が測定可能な改善を実証できるようにします。これらの結果は、企業のセキュア・コーディング・トレーニングが現代の開発環境全体にわたって大規模に実施することによる測定可能な影響を示しています。

改善する時間

What developers learn in AI security training

Coverage spans LLM vulnerabilities, agent protocols, infrastructure security, and foundational AI security design — mapped to real developer workflows.

Practice real-world AI and LLM security risks.

AI security training teaches developers how to identify, prevent, and remediate vulnerabilities in AI-generated code and modern AI systems, including:

Build foundational AI security knowledge

Developers learn how to securely design and review AI systems through:

Secure AI agents, protocols, and cloud AI environments

Understand and mitigate risks across agent-based systems and AI infrastructure, including MCP and cloud AI services:

Secure AI services and model integrations

Model Context Protocol — Secure AI agents and protocol interactions

AI ガバナンスチーム専用設計

測定可能な開発者コンピテンシーを実証し、人的開発とAI支援開発におけるソフトウェアリスクを軽減します。

安全なコードは安全な開発者から始まります

安全なコーディングスキルを強化し、導入された脆弱性を減らし、組織全体で測定可能な開発者の信頼を築きましょう。

実践的なセキュア・コーディング学習で脆弱性を軽減

Secure Code Warriorがどのように開発者のセキュリティスキルを向上させ、脆弱性を軽減し、測定可能なリスク削減を実現するかをご覧ください。