在开始前阻止AI软件的风险

无论谁编写了什么代码,每次提交时都能确保交付安全且高质量的代码。

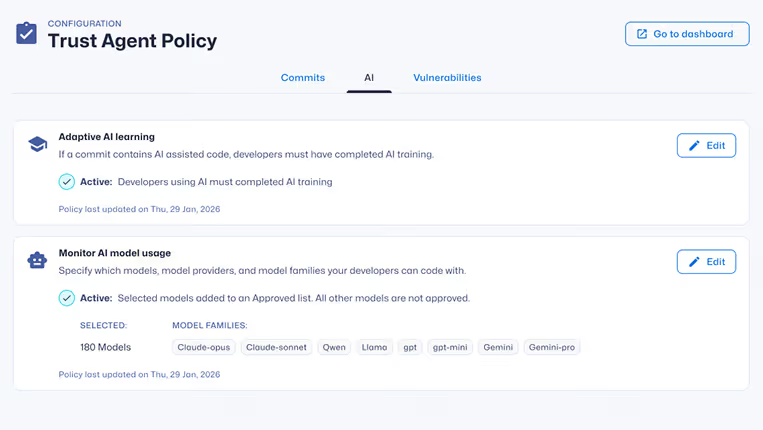

人工智能软件治理

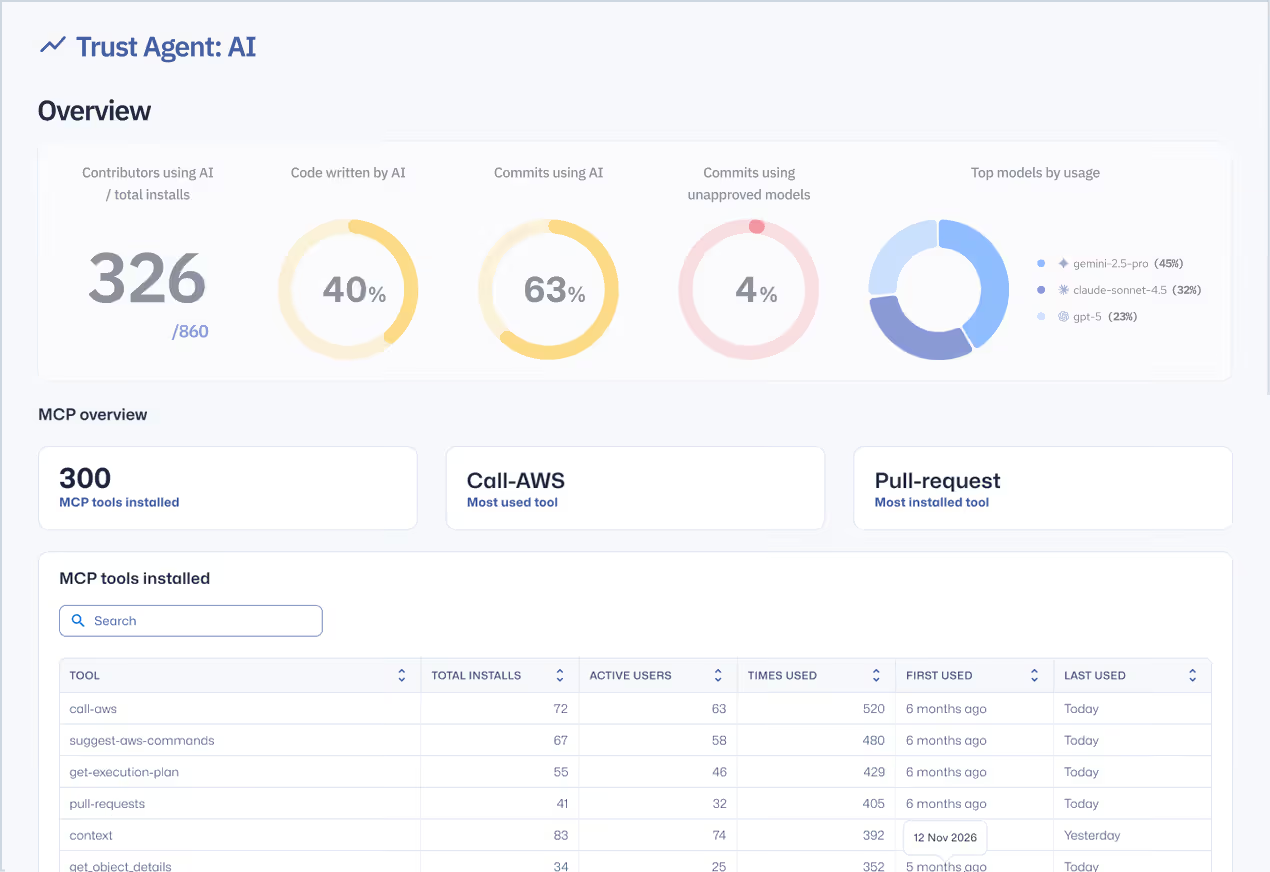

由人工智能主导开发的控制平面

通过人工智能主导的开发,实现可视化、安全性和弹性,在正式运行前防范漏洞,使团队能够充满信心地快速行动。

大规模企业治理,自信的AI开发。

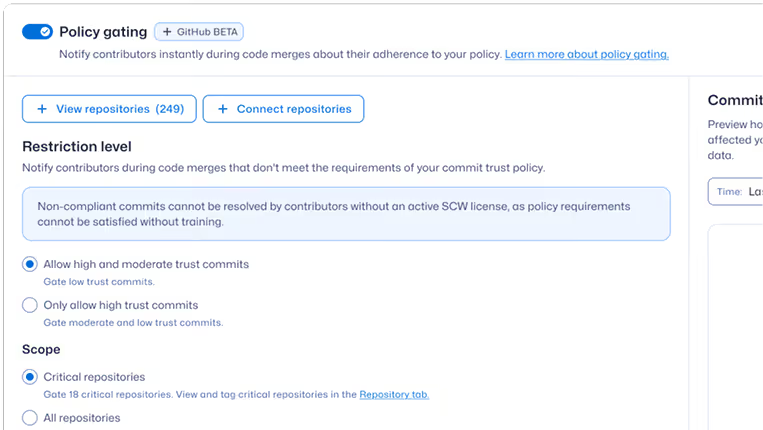

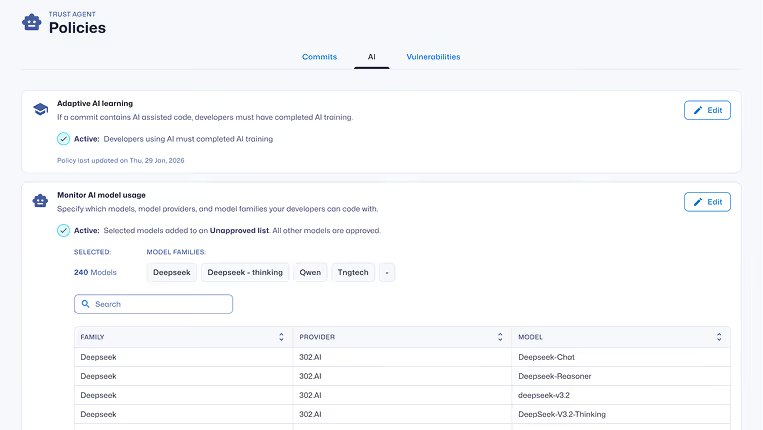

建立政策,实现全公司范围的可视性,并在整个开发生命周期中防止由人工智能引发的失控风险。

可视化AI生成的代码量

- 在整个AI工作流中定义并应用安全开发政策

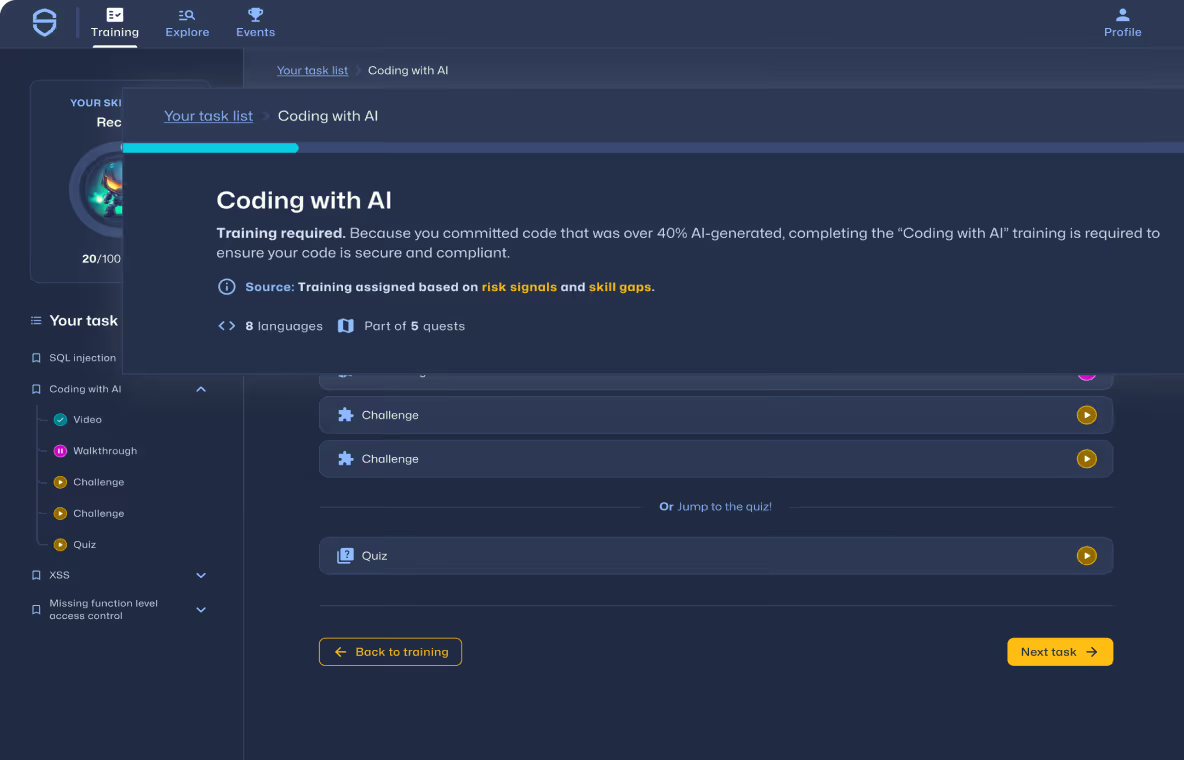

- 加强工程团队的安全编码能力

- 针对多种语言和漏洞的实践培训访问

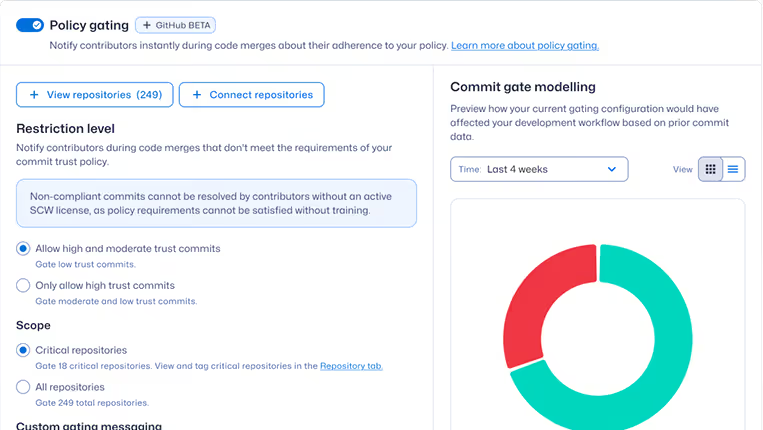

在提交时防止AI引入的漏洞

导入的漏洞减少了53%以上

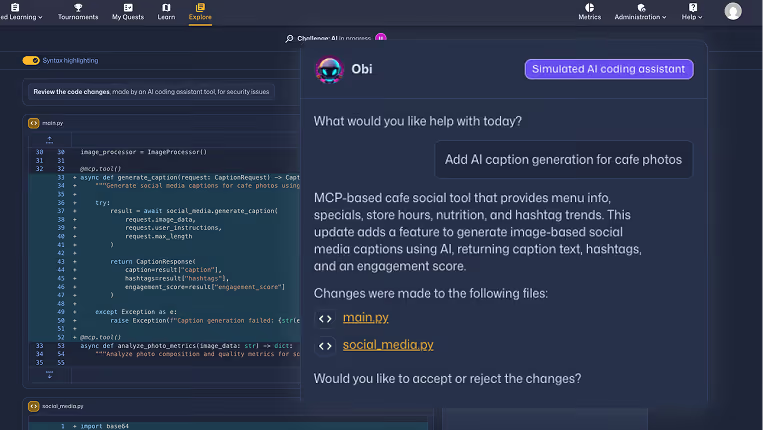

- 在开发者和AI主导的工作流中构建安全编码功能

- 在开发者工具中直接提供符合政策导向的指导

- 了解人工智能生成的代码如何影响软件风险

在不降低速度的情况下扩大人工智能开发

平均修复时间(MTTR)最高可降低82%

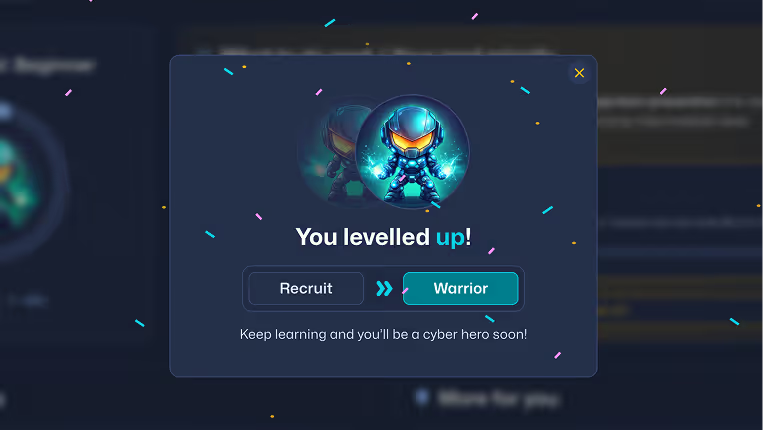

- 通过自适应学习和实践实验室促进可测量的技能提升

- 在开发者工具中提供实时指导

- 尽早修复漏洞以降低返工成本

我们如此出色的理由

安全可靠,并能与您现有的工具无缝集成

近日公开

概念性且互动的学习活动

11k+

脆弱性主题与安全概念

650+

15种编程语言的AI挑战

800+

编程语言与框架

75+

学习

从源头减轻脆弱性

通过在实际开发人员工作流程中实施实践性安全编码与AI安全学习,可将组织漏洞减少53%以上。

出货前安全的人工智能主导型开发

在整个软件开发生命周期中,识别开发人员的风险、实施安全策略并防范漏洞。

资源中心

开始所需的资源

公司

May 6, 2026

Securing the Future of Software: Why Secure Code Warrior and KnowBe4 Are Joining Forces

I am thrilled to announce today an upcoming strategic partnership between Secure Code Warrior and KnowBe4. KnowBe4 is a world-renowned leader in comprehensively managing human and agentic AI risk, making them the perfect partner to help us distribute foundational security awareness to organizations across the globe.

关于人工智能软件治理的常见问题解答

理解人工智能软件治理及降低人工智能驱动的软件风险的方法

了解什么是人工智能软件治理、Secure Code Warrior 人工智能辅助开发。

.png)