在人工智能软件风险发生前就将其扼杀在萌芽状态

每次提交都确保代码安全可靠、质量上乘——无论由谁(或什么)编写。

.svg)

.svg)

人工智能软件治理

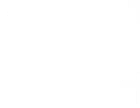

人工智能驱动开发的控制平面

让人工智能驱动的开发过程可视化、安全且具有弹性——在生产环境部署前消除漏洞,让团队能够快速推进工作,充满信心。

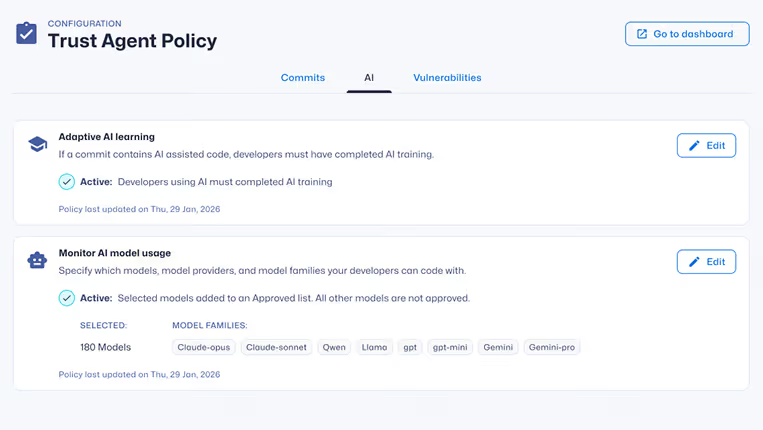

在软件开发全过程中落实人工智能治理。

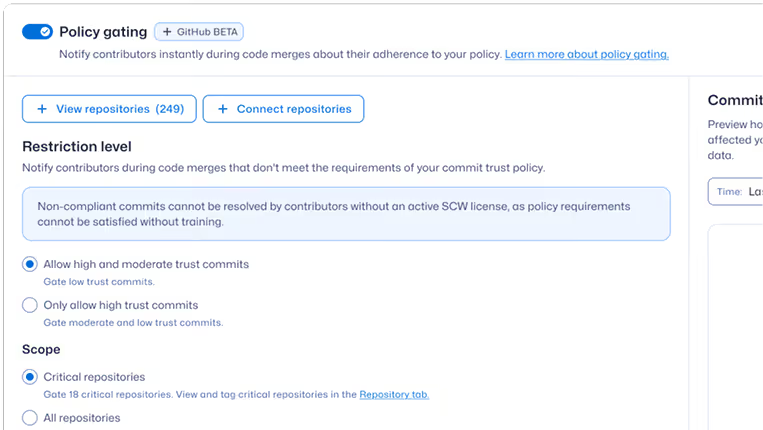

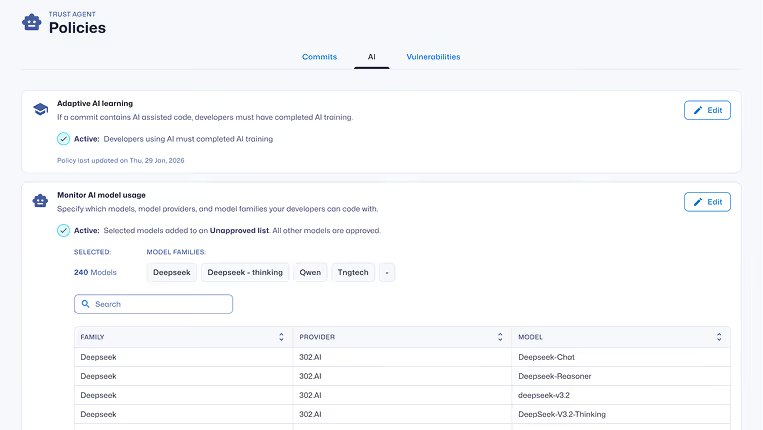

在保持安全监督的同时启用AI辅助开发。全面掌握AI使用情况,在提交时应用治理工作流,并使开发实践符合企业风险阈值。

安全扩展人工智能软件开发

- 实现企业级人工智能辅助开发的可视化管理

- 加强工程团队的安全编码能力

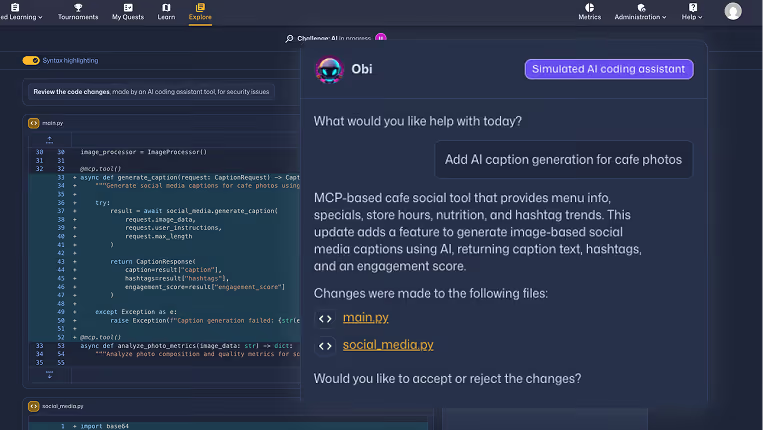

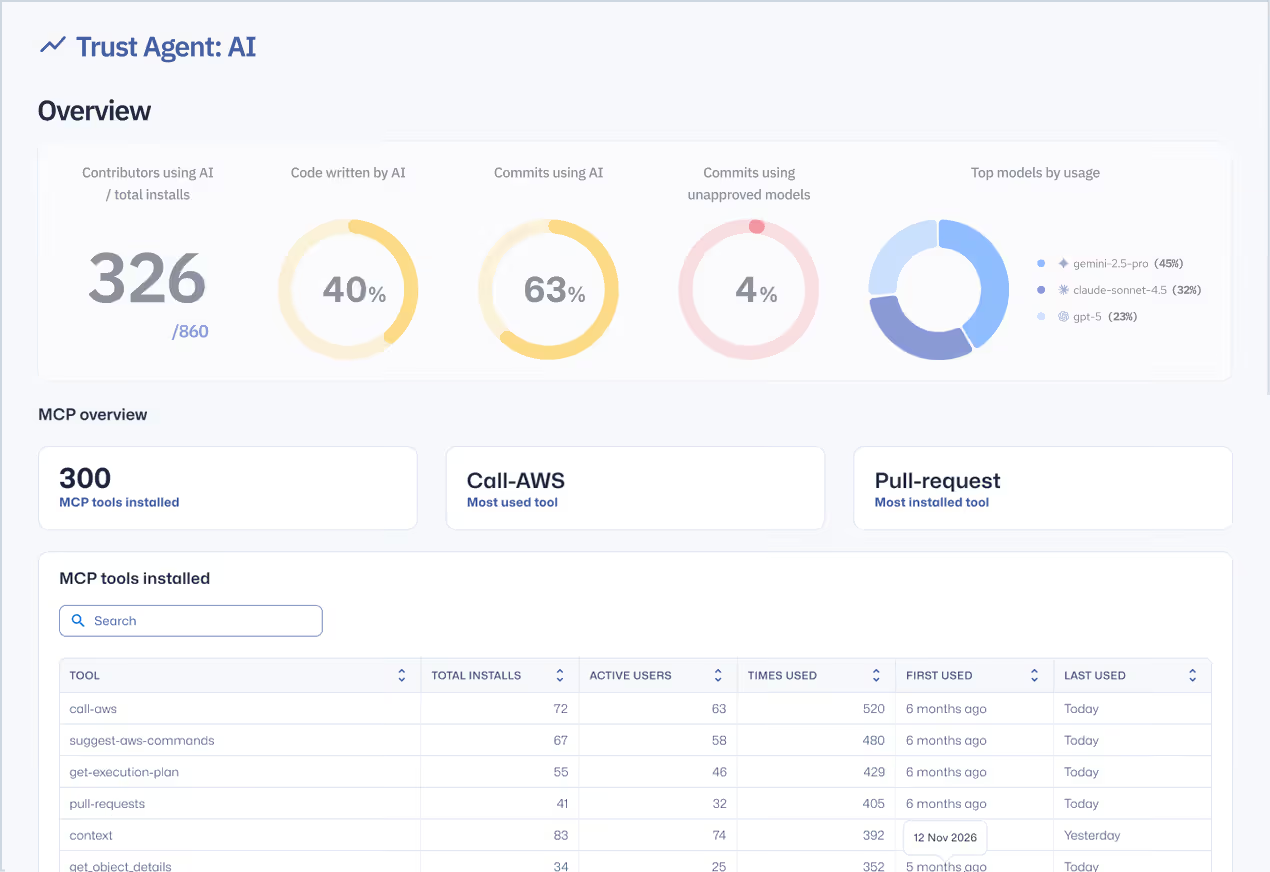

- 培训开发人员安全审查人工智能生成的代码

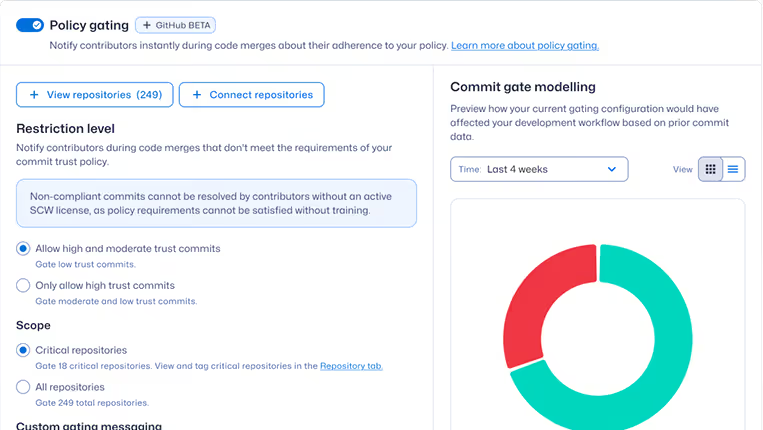

在提交时防止AI引入的漏洞。

使人工智能使用情况可视化,在代码提交时应用安全编码防护措施,并确保人工智能辅助开发符合安全标准,从而防止人类编写代码与人工智能生成代码中的漏洞。

减少引入的漏洞数量达53%以上

- 在开发团队中建立安全编码能力

- 在开发者工具中直接提供符合政策导向的指导

- 了解人工智能生成的代码如何影响软件风险

在不延缓交付的前提下扩展人工智能开发。

让人工智能辅助开发更安全、更可衡量——减少返工,规避安全审查瓶颈,助力团队更快交付,信心十足。

将平均修复时间缩短高达82%

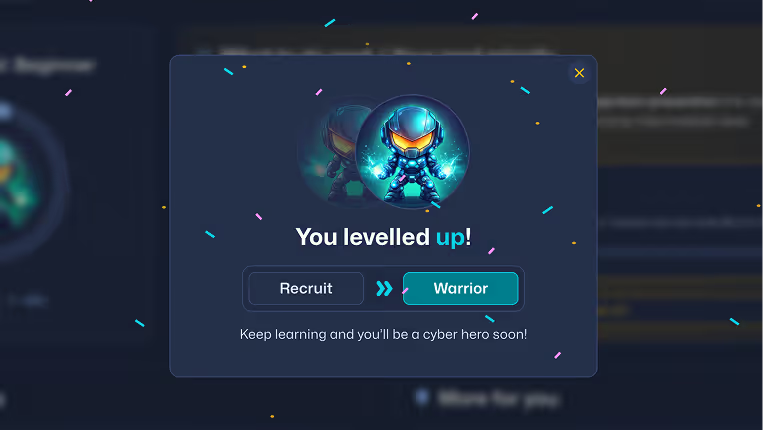

- 通过自适应学习提升开发人员的安全技能

- 在开发者工具中提供实时指导

- 尽早修复漏洞以降低返工成本

为什么我们很棒

安全可靠,专为您的常用工具打造

*进行中

总互动学习活动

11k+

漏洞主题与安全概念

650+

人工智能/大型语言模型专项学习活动

800+

编程语言与框架

75+

学习

从源头减少漏洞

通过实际操作实现安全编码与人工智能安全学习,融入真实开发人员工作流程——助力企业将漏洞减少53%以上。

管理

Scale AI-driven development with confidence

Gain visibility into how AI contributes to your code, connect activity to real risk, and align development to enterprise standards — so you can reduce risk and prove trust before code reaches production.

在人工智能驱动的开发成果发布前进行管控

在软件开发生命周期中识别开发者风险、执行政策并防范漏洞。

资源中心

资源

人工智能软件治理常见问题解答

理解人工智能软件治理及其降低人工智能驱动软件风险的方法

了解什么是人工智能软件治理,为何它至关重要,以及Secure Code Warrior 如何Secure Code Warrior 组织安全采用人工智能辅助开发。

.png)