信任代理:AI捕获AI使用信号和提交元数据——而非源代码或提示词——在 保护开发者隐私的同时实现大规模治理。

它使人工智能辅助开发在安全的软件开发生命周期中变得可视化、可审计且可管理,帮助组织在代码进入生产环境前识别并降低开发人员风险。

信任代理:人工智能在代码创建环节实现人工智能网络安全治理。

人工智能编码助手、大型语言模型API、命令行界面代理以及连接MCP的工具,如今正每日影响着生产代码。开发速度的提升带来了软件生命周期中治理复杂性的新挑战。

信任代理:人工智能将AI软件治理融入软件开发生命周期。它为AI辅助开发提供可视化管理,关联提交时的风险,并使组织能够安全地扩展AI编码规模。

通过关联AI工具与模型使用情况、代码仓库活动、提交元数据、开发者信任评分®及漏洞基准数据,Trust Agent: AI助力企业:

它使人工智能辅助开发在安全的软件开发生命周期中变得可视化、可审计且可管理,帮助组织在代码进入生产环境前识别并降低开发人员风险。

传统应用安全工具在代码编写完成后才检测漏洞。Trust Agent在代码提交时强制执行AI模型限制和安全编码政策——在漏洞进入生产环境前就将其扼杀在萌芽状态。

Capture observable AI tool and model usage across developer workflows, correlating activity to repositories, contributors, and governance posture.

Surface 积极使用的 MCP 提供商、受影响用户及存储库暴露情况——为人工智能工具供应链建立治理基准。

关联AI使用信号、提交元数据、开发者信任评分®及漏洞基准,在代码进入生产环境前识别高风险暴露点。

基于提交风险、AI影响力和开发者信任评分®触发精准学习——减少重复性漏洞。

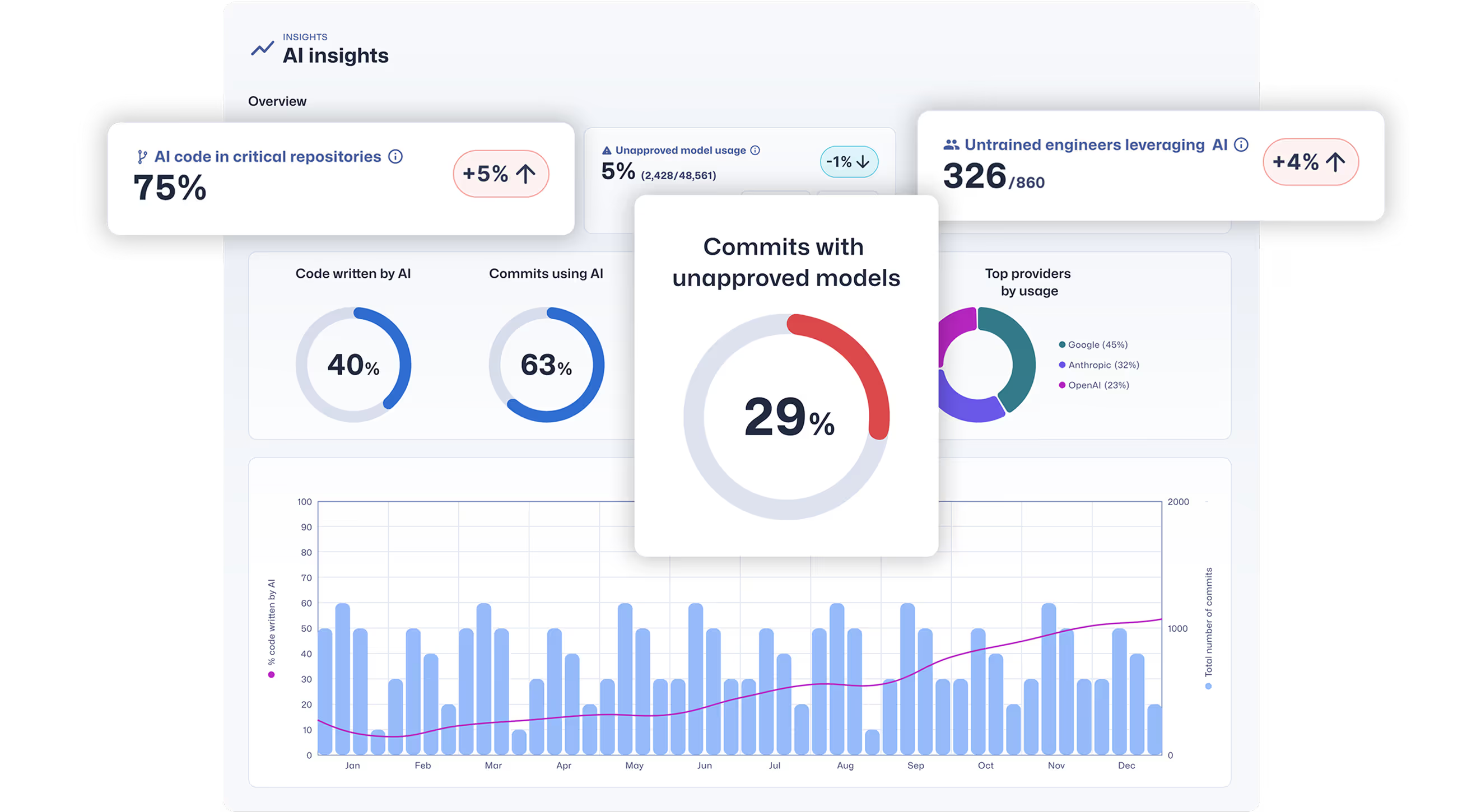

提供可供高管使用的仪表盘,展示AI使用趋势、MCP可见性及引入的漏洞指标——无需存储源代码或提示信息。

信任代理:人工智能融入现代AI辅助开发工作流——支持生态系统中成熟与新兴的各类工具。

支持的环境包括:

Trust Agent:AI支持主要大型语言模型(LLM)提供商,包括:

信任代理:通过降低AI引入的风险、强化提交级别的责任追溯能力,并在AI辅助开发全流程中实施可执行的治理机制,该方案将AI治理从静态政策转化为可量化的提交级控制——使AI应用转化为基于证据的安全成果。

了解Trust Agent: AI如何在人工智能辅助开发过程中实现可视化、关联分析和策略控制。

了解Trust Agent: AI如何在您的安全软件开发生命周期中,使AI辅助开发变得可视化、可衡量且可执行。