来自全球第一的安全编码培训公司

人工智能软件供应链问题

人工智能已扩展您的软件供应链

人工智能编码助手、大型语言模型及MCP连接代理现已贯穿软件开发生命周期(SDLC)生成生产代码。开发速度虽已加速,治理却未能同步跟进。人工智能已成为软件供应链中不受管控的贡献者。

大多数组织无法明确回答:

- 哪些AI模型生成了特定的提交记录

- 这些模型能否始终如一地生成安全的代码

- 哪些MCP服务器处于活动状态,以及它们访问的内容

- 人工智能辅助提交的代码是否符合安全编码标准

- 人工智能应用如何影响整体软件风险

有效的人工智能软件治理需要:

跨存储库的人工智能工具和模型使用情况可见性

提交层面的风险关联性与政策指导

衡量人类与人工智能辅助软件开发生命周期中的安全编码能力

缺乏结构化的AI软件治理机制,组织将面临所有权分散、可视性受限及风险暴露加剧的困境。

人工智能辅助开发虽能提升代码生成速度,但若缺乏可执行的监督机制,也将加剧引入的漏洞风险与模型供应链暴露问题。

什么是人工智能软件治理?

对人工智能驱动的开发进行监督

人工智能软件治理使AI生成的代码可视化,关联提交级别的风险,并使AI驱动的开发与安全策略保持一致。它贯穿软件开发生命周期,将AI使用可见性、风险情报与开发者能力洞察有机结合。

它使组织能够:

- 了解人工智能在何处以及如何被用于生成代码

- 关联人工智能辅助提交与软件风险

- 制定人工智能使用政策及治理标准

- 在人类编写的代码和人工智能生成的代码之间建立责任机制

为何软件开发生命周期中的人工智能软件治理至关重要:

人工智能加速发展

人工智能拓展您的软件供应链

人工智能引入模型风险与新型威胁

人工智能可能导致责任归属的缺口

核心能力

管理并安全扩展人工智能驱动的软件开发

传统应用安全工具在代码编写完成后才检测漏洞。人工智能软件治理则能提供对AI模型使用情况的可视化监控,在代码提交时关联风险信号,并帮助组织将开发流程与安全编码政策保持一致。

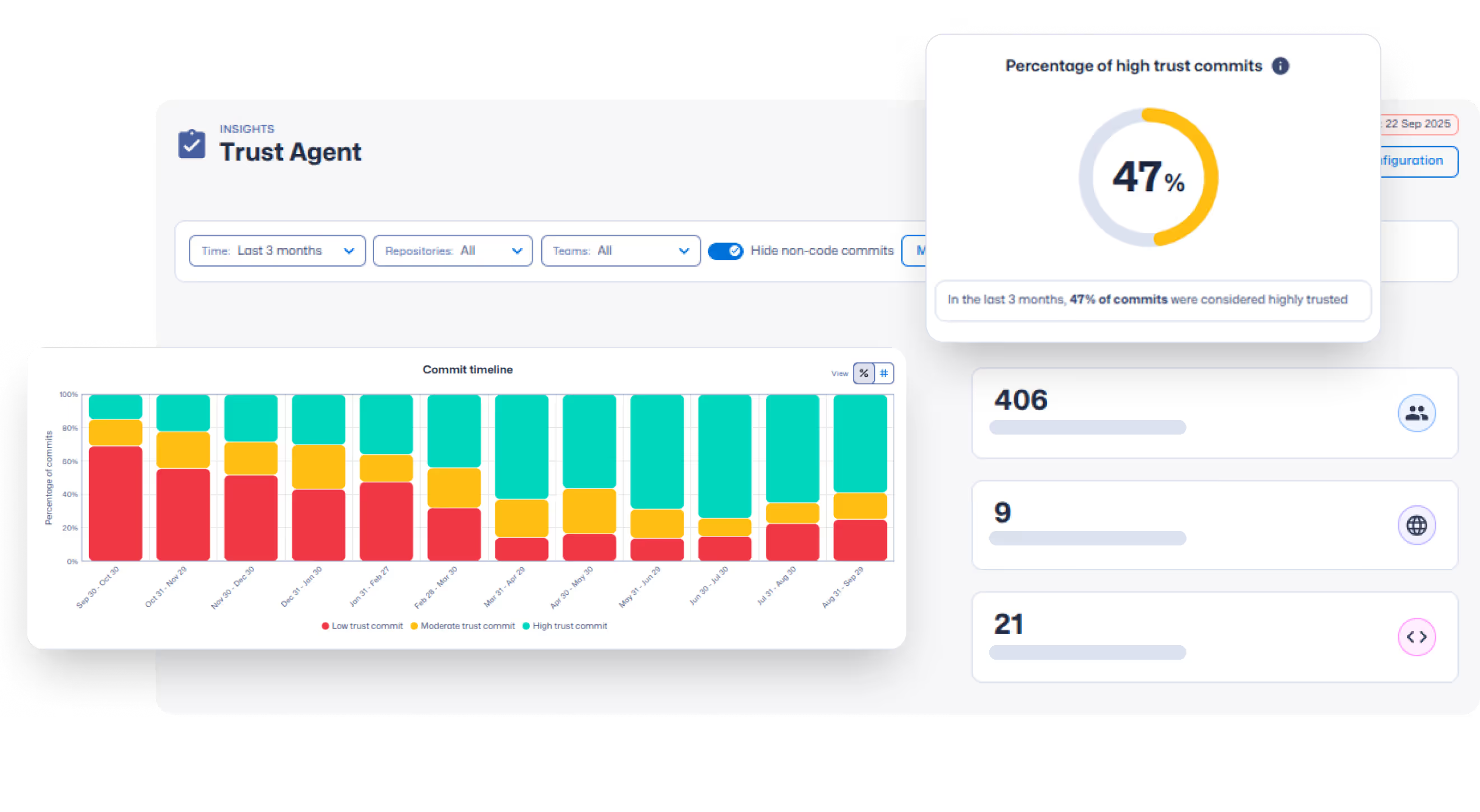

人工智能工具与模型可追溯性

看看AI如何生成代码

了解哪些人工智能工具贡献了代码——创建可验证的人工智能软件组件清单(SBOM)。

暗影人工智能检测

揭露未经授权的人工智能使用行为

识别在未经批准的治理政策之外运行的未经授权的人工智能工具。

LLM安全基准测试

安全优先的模型选择

获取真实世界的人工智能性能指标,以指导批准模型的使用。

风险评分

在生产前理解风险

关联人工智能辅助提交与风险信号,触发针对性学习以降低漏洞风险。

MCP 服务器可见性

追踪人工智能代理的供应链

识别模型上下文协议服务器,并理解人工智能代理如何与内部系统进行交互。

开发者发现

识别隐性贡献者

持续识别开发人员及提交模式,以强化责任追溯与风险可视性。

适用对象

专为人工智能治理团队打造

专为负责保障软件开发安全的领导者设计,随着人工智能日益成为生产代码的核心贡献者。

在发布前管控人工智能驱动的开发

了解AI工具如何生成代码、关联提交与风险信号,并在整个AI软件供应链中保持可视性。

人工智能软件治理平台常见问题解答

控制、测量和保障人工智能辅助的软件开发

了解Secure Code Warrior 如何在人工智能辅助开发工作流中Secure Code Warrior AI可观测性、策略执行和治理能力。