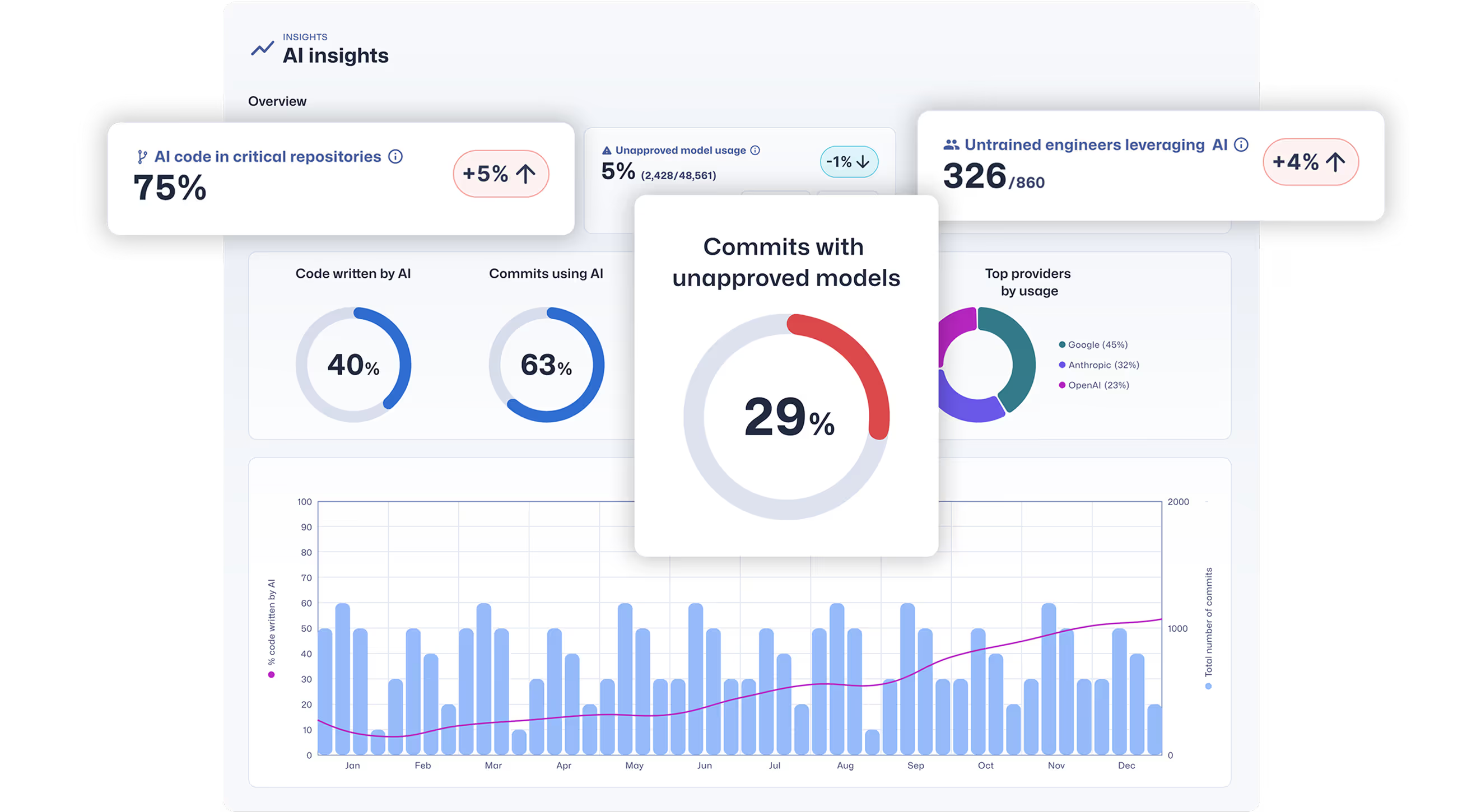

Agent de confiance : l'IA capture les signaux d'utilisation de l'IA et valide les métadonnées, et non le code source ou les instructions, tout en préservant la confidentialité des développeurs tout en permettant une gouvernance à grande échelle. Il rend le développement assisté par l'IA auditable et géré à travers le SDLC sécurisé, gérant ainsi les risques pour les développeurs avant la production.

它使人工智能辅助开发在安全的软件开发生命周期中变得可视化、可审计且可管理,帮助组织在代码进入生产环境前识别并降低开发人员风险。