Trust Agent: AI는 소스 코드나 프롬프트가 아닌 AI 사용 신호와 커밋 메타데이터를 캡처하여 개발자 개인 정보를 보호하는 동시에 대규모 거버넌스를 지원합니다.이를 통해 안전한 SDLC에서 AI 지원 개발을 감사하고 관리할 수 있으므로 프로덕션 전에 개발자 위험을 관리할 수 있습니다.

它使人工智能辅助开发在安全的软件开发生命周期中变得可视化、可审计且可管理,帮助组织在代码进入生产环境前识别并降低开发人员风险。

信任代理:人工智能在代码创建环节实现人工智能网络安全治理。

AI 코딩 어시스턴트, LLM API, CLI 에이전트 및 MCP 연결 도구는 이제 매일 프로덕션 코드에 영향을 미칩니다.개발 속도가 빨라지면서 소프트웨어 라이프사이클 전반에 걸쳐 새로운 거버넌스 복잡성이 도입되었습니다.

它使人工智能辅助开发在安全的软件开发生命周期中变得可视化、可审计且可管理,帮助组织在代码进入生产环境前识别并降低开发人员风险。

기존 애플리케이션 보안 툴은 코드 작성 후 취약점을 탐지합니다.Trust Agent는 커밋 시 AI 모델 제한 및 보안 코딩 정책을 적용하여 도입된 취약성이 프로덕션에 들어가기 전에 이를 방지합니다.

개발자 워크플로우 전반에서 관찰 가능한 AI 도구 및 모델 사용을 캡처하여 활동을 리포지토리, 기여자 및 거버넌스 태세와 연관시킵니다. 디스커버리 및 인텔리전스

Surface는 활발히 사용하는 MCP 공급업체, 영향을 받는 사용자, 리포지토리 노출을 통해 AI 도구 공급망에 대한 거버넌스 기준을 설정했습니다.

AI 사용 신호, 커밋 메타데이터, 개발자 Trust Score® 및 취약성 벤치마크의 상관 관계를 분석하여 코드가 프로덕션에 도달하기 전에 노출 증가를 식별합니다.

커밋 위험, AI 영향력, 개발자 Trust Score® 를 기반으로 표적 학습을 트리거하여 반복되는 취약성을 줄입니다.

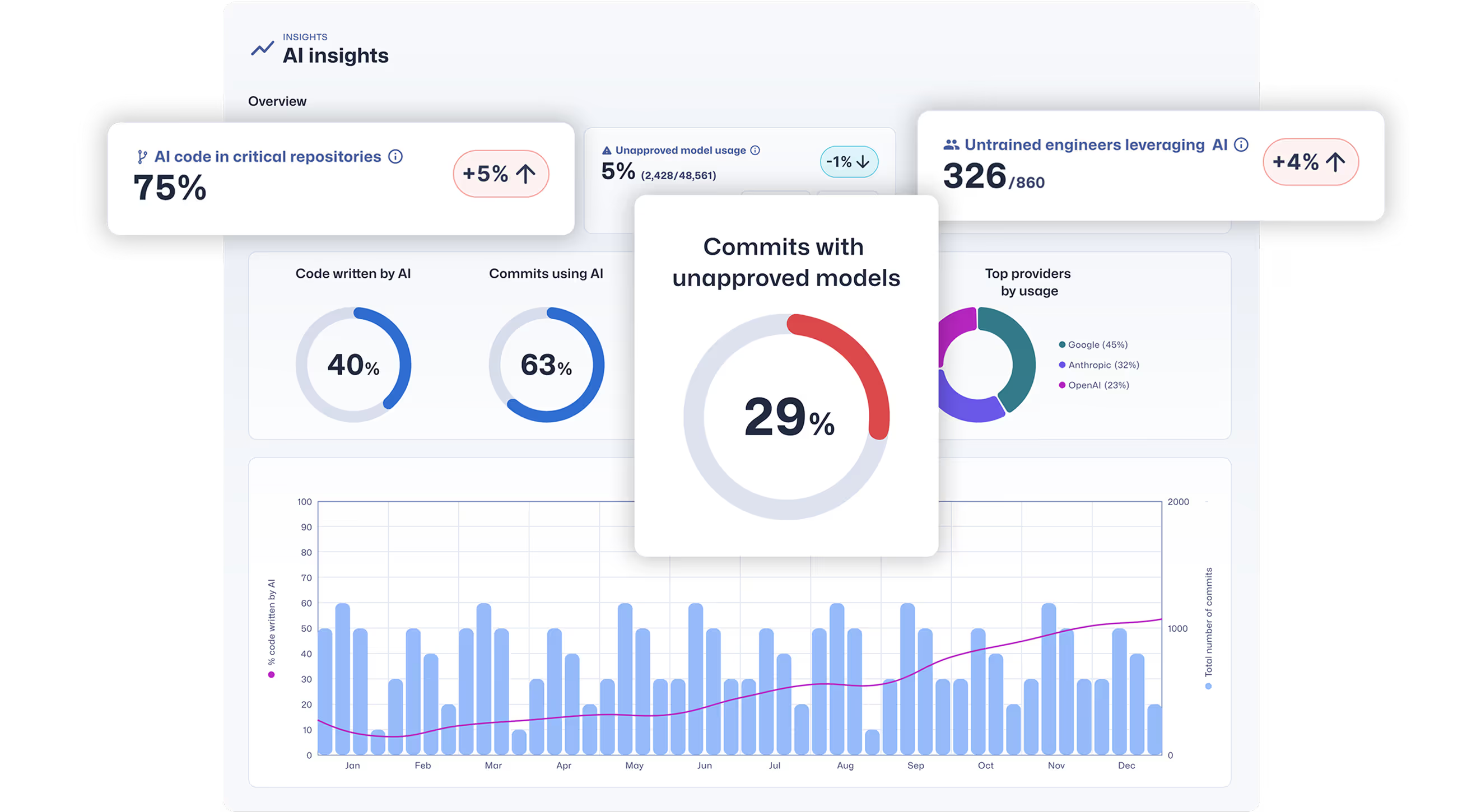

소스 코드나 프롬프트를 저장하지 않고도 AI 사용 추세, MCP 가시성, 도입된 취약성 메트릭이 포함된 경영진용 대시보드를 제공합니다.

Trust Agent: AI는 최신 AI 지원 개발 워크플로우에 통합되어 생태계 전반에서 기존 도구와 새로운 도구를 모두 지원합니다.

지원되는 환경은 다음과 같습니다.

트러스트 에이전트: AI는 다음을 포함한 주요 LLM 공급자를 지원합니다.

Trust Agent: AI는 AI로 인한 위험을 줄이고 커밋 수준의 책임을 강화하며 AI 지원 개발 전반에 걸쳐 시행 가능한 거버넌스를 제공합니다.AI 거버넌스를 정적 정책에서 측정 가능한 커밋 수준의 제어로 전환하여 AI 채택을 증거 기반 보안 결과로 전환합니다.

Trust Agent: AI가 AI 지원 개발 전반에서 가시성, 상관관계 및 정책 제어를 어떻게 제공하는지 알아보십시오.

Trust Agent: AI를 통해 보안 SDLC 전반에서 AI 지원 개발을 가시적이고 측정 가능하며 시행할 수 있는 방법을 알아보세요.